在 In-Context RL 的研究热潮中,往往存在一种惯性思维,认为只要把 Transformer 做大,把上下文窗口拉长,模型就能像 AD (Algorithm Distillation) 或 DPT (Decision-Pretrained Transformer) 那样“顿悟”出最优策略。

然而实验结果表明,现有的 In-Context RL 方法存在显著局限。它们本质上更接近于条件行为克隆。

如果你喂给模型的是专家数据,它能模仿得很好。但如果上下文里充斥着次优甚至随机的轨迹(这在实际应用中才是常态),模型往往会拟合这些次优行为,从而继承了策略偏差,难以超越演示者的水平。

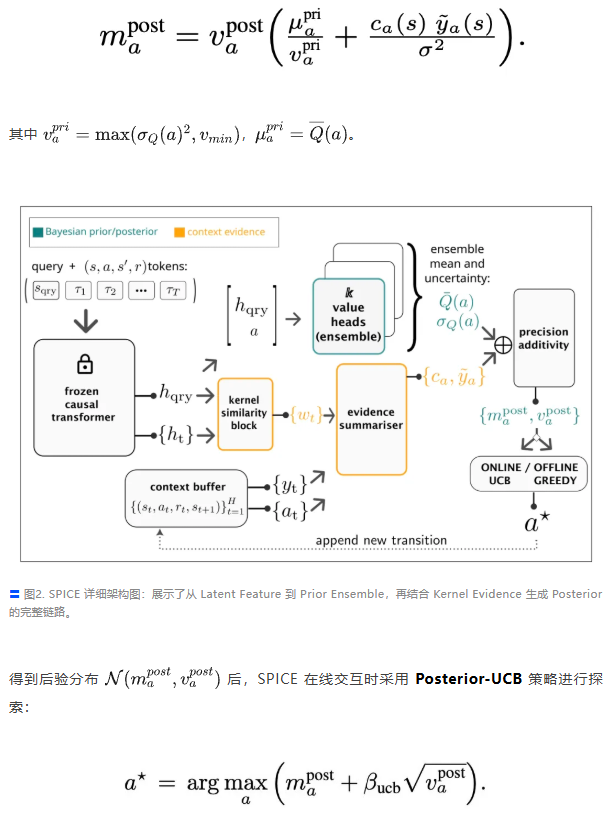

近日,由 Yoshua Bengio 领衔的 Mila 实验室团队发布了一项新工作 SPICE,这项工作并没有在模型参数量上死磕,而是将深度集成 (Deep Ensemble)、贝叶斯推断与 Transformer 进行了优雅的结合。

SPICE 的核心洞察在于,不要把预训练模型仅仅当作一个动作预测器,而应将其视为一个提供“价值先验”的工具。

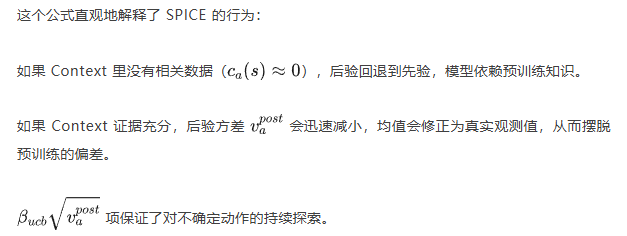

在测试时(Test-time),通过显式的贝叶斯公式将这个先验与上下文证据融合,利用 UCB(置信上界)算法进行决策。

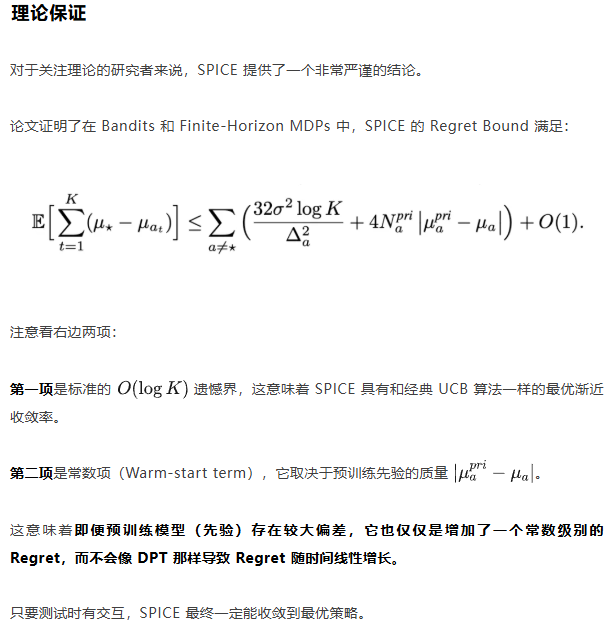

即便是在预训练数据质量极差的情况下,SPICE 依然在理论上被证明具有对数级遗憾界 (Logarithmic Regret),并在实验中展现出显著优于 DPT 等基线模型的性能。

论文标题:

In-Context Reinforcement Learning through Bayesian Fusion of Context and Value Prior

论文链接:

https://arxiv.org/pdf/2601.03015

01

当In-Context RL遇到“烂数据”

这带来了一个棘手的问题——行为策略偏差 (Behaviour-Policy Bias)。

如果预训练数据的生成策略是次优的,或者带有很强的噪声,基于 MLE(最大似然估计)训练出来的模型就会继承这种偏差。

在推理阶段,如果 Context 里的历史数据也是次优的,模型很难通过自身的归纳偏置去推断出最优解,通过简单的 Attention 机制很难无中生有地产生探索(Exploration)行为。

要想在 Test-time 实现真正的强化学习(即能够探索并改进策略),我们需要两个关键要素,而这正是现有 Transformer 架构所缺失的:

1. 对 Q 值的显式估计:不仅仅是预测动作概率;

2. 不确定性量化:知道自己在哪里不知道,从而驱动探索。

02

方法论:先验、证据与融合

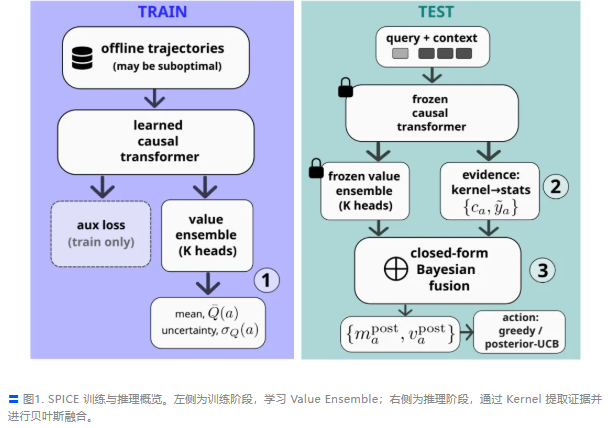

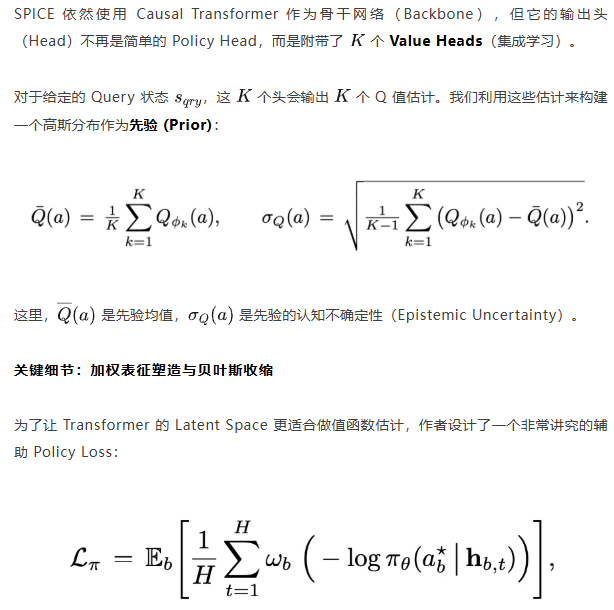

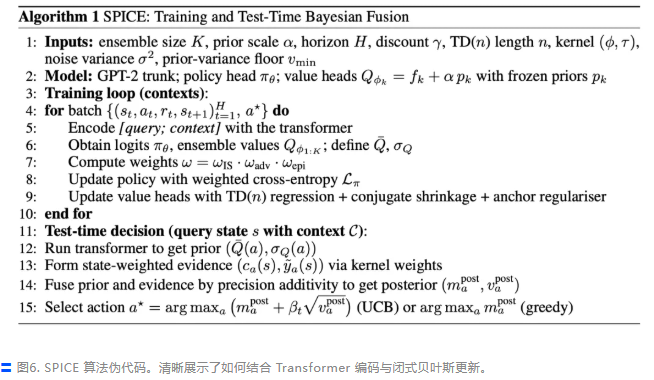

SPICE 的全称是 Shaping Policies In-Context with Ensemble prior。它的架构并不复杂,核心在于如何优雅地处理预训练知识和当前上下文之间的关系。

SPICE 的工作流可以拆解为三个步骤:

1. 训练阶段:学习价值先验

03

04

实验结果:显著优于DPT

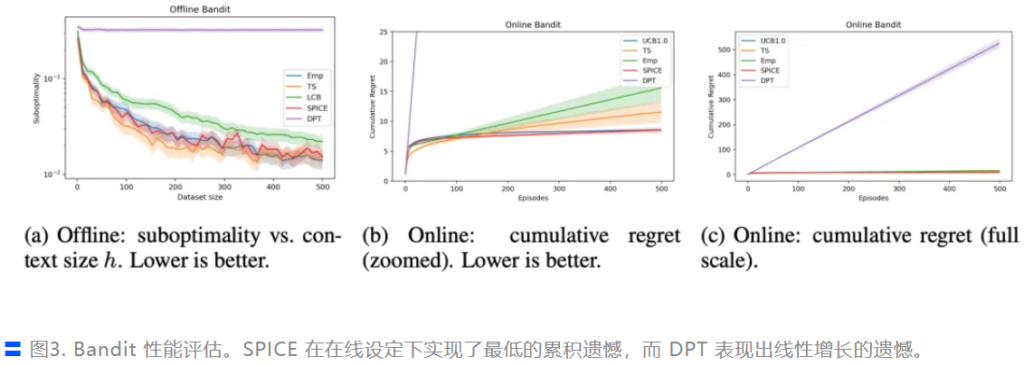

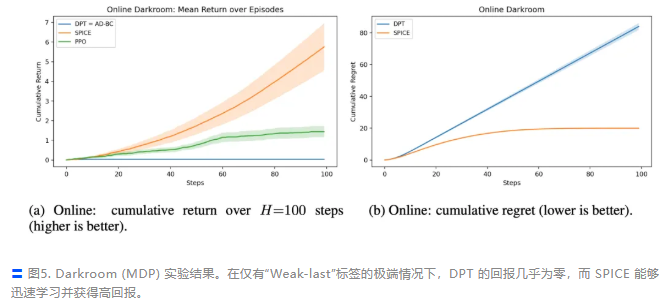

为了验证“烂数据”下的适应能力,作者在 Bandits 和 Darkroom(2D 导航)环境中设计了非常苛刻的实验条件。

特别是在 Darkroom 实验中,预训练数据的标签采用 “Weak-last” 设定,即标签不是最优动作,而是随机策略轨迹的最后一步动作。这基本上就是噪音极大的次优数据。

1. Bandit实验:拒绝线性Regret

从上图可以看出,在 Online 设定下,SPICE 取得了所有学习型方法中最低的累积遗憾(Cumulative Regret),并紧密跟随经典 UCB 算法的表现。

相比之下,DPT 的最终遗憾值比 SPICE 高出两个数量级,这表明 DPT 未能从微弱的日志数据中适应,而 SPICE 真正实现了 In-Context 的策略改进。

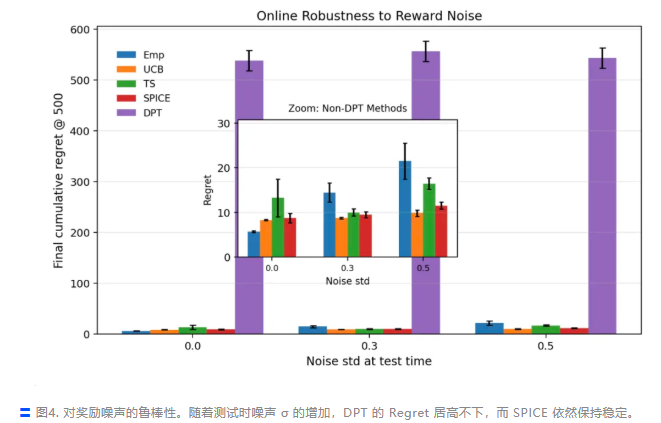

2. 鲁棒性:无惧噪声

上图结果表明,随着测试环境奖励噪声的增加,SPICE、Thompson Sampling 和 UCB 的表现仅发生微小的绝对变化,保持了良好的稳健性。

反观 DPT,其最终遗憾值始终居高不下,且对噪声变化几乎不敏感,进一步印证了其在次优数据训练下的适应性缺陷。

3. MDP实验:从零到一的质变

在 Darkroom 这种涉及序列决策的任务中,实验结果显示 SPICE 能够迅速适应环境并获得高回报,其遗憾曲线在短暂的热身(Warm-up)后迅速趋于平缓。

作为对比,DPT 和 AD-BC 在这种弱监督设定下表现出近乎线性的遗憾增长,且回报几乎为零。

这说明缺乏不确定性量化的方法在面临“烂数据”时,难以跳出模仿次优行为的陷阱。

05

结语

SPICE 这篇论文并没有盲目地堆砌 Transformer 的参数,而是回归了强化学习的本质——价值估计与不确定性量化。

它通过引入 Deep Ensemble 和贝叶斯融合,巧妙地解决了 In-Context RL 中的两个核心难题:

1. 如何利用次优数据?把它当先验,而不是当真理。

2. 如何实现测试时探索?用后验不确定性驱动 UCB,而不是简单模仿。

Algorithm 1 的伪代码也非常简洁,非常适合作为后续研究的 Baseline。

当然,SPICE 也有其局限性。目前它依赖于 Kernel 函数来衡量状态相似度,在高维或部分可观测(POMDP)环境中,设计一个好的 Kernel 依然具有挑战性。

–文章来源<PaperWeekly>

Comments NOTHING