作为 AI 领域顶会中的顶会,NeurIPS 2025 的 Best Paper 历来是引领行业方向的 “风向标”。今年这篇题为《Gated Attention for Large Language Models: Non-linearity, Sparsity, and Attention-Sink-Free》的论文,以简单却有效的改进思路,解决了大模型注意力机制的核心痛点,还成功落地于 Qwen3-Next 系列模型。今天就带大家逐帧拆解这篇 “封神之作”,看懂门控注意力如何重塑大模型性能边界~

论文的motivation分析

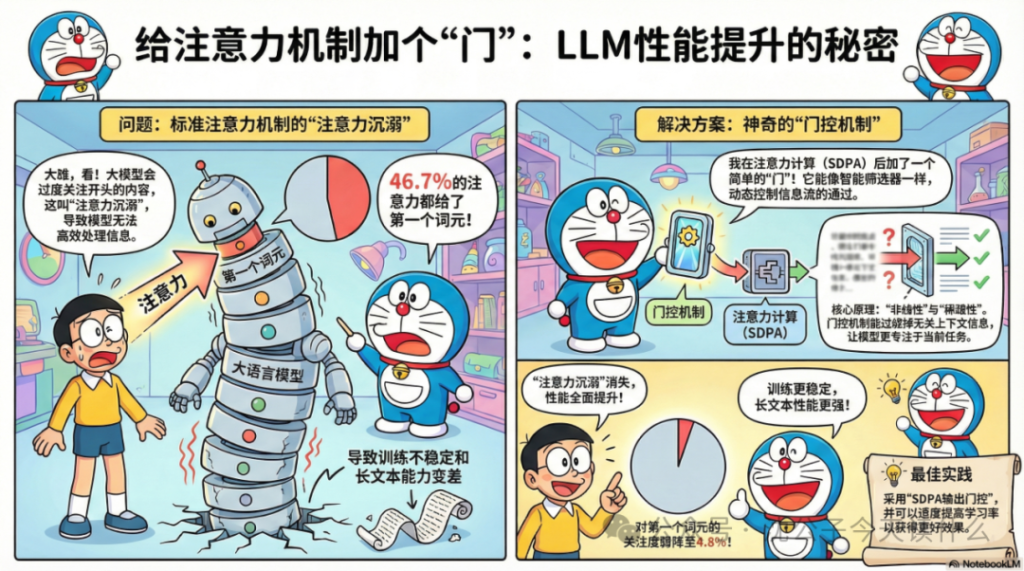

现有的 Transformer 模型核心组件是 Softmax Attention。虽然它很强大,但 Softmax 有一个机制上的“强迫症”:输出概率之和必须为 1。这意味着,哪怕当前的上下文中没有任何有价值的信息,模型也必须强行把注意力分配给某些 token。这导致了两个严重问题:

注意力耗散:为了凑够 1,模型被迫关注无关信息。 Attention Sink(注意力黑洞):模型学会了一种“作弊”手段,把多余的注意力全部扔给第一个 token(或其他特定 token),即便这个 token 没有任何实际语义。这导致第一个 token 承载了巨大的注意力权重,产生“Massive Activations”(巨大的激活值),这对量化和训练稳定性都是隐患。

尽管 LSTM 或 SSM(如 Mamba)都有门控机制来控制信息流,但标准 Transformer Attention 缺乏一种能主动“拒收”信息的机制。作者希望探究:如果在 Attention 输出处加一个“门控”,是否能解决上述问题?

论文主要贡献点分析

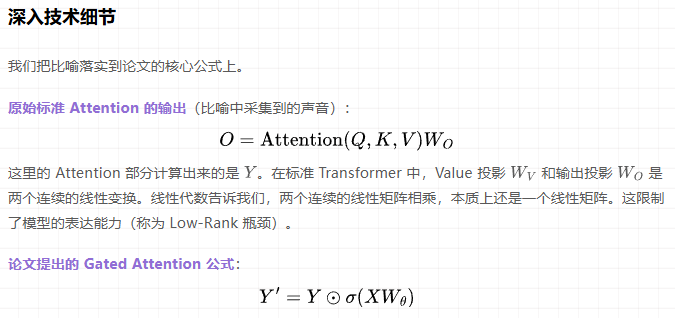

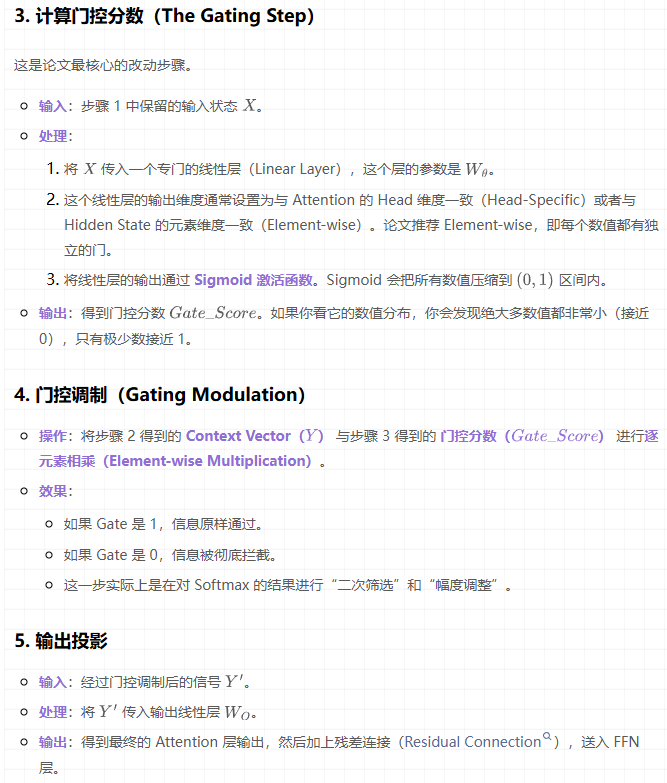

核心创新点:提出了一种简单但高效的 Gated Attention(门控注意力) 机制。具体做法是在 Scaled Dot-Product Attention(SDPA)的输出之后,直接加一个由 Sigmoid 激活函数控制的门。 关键技术支撑: 非线性增强:引入门控打破了 Value 投影层()和输出投影层()之间连续线性变换导致的低秩(Low-Rank)瓶颈。 自适应稀疏性:利用 Sigmoid 的特性,让模型根据输入(Query)自动关闭不重要的信息流,从而自然地消除了“Attention Sink”现象。

显著性结果: 该方法已被应用于 Qwen3-Next 预研模型。 在 15B MoE 和 1.7B Dense 模型上的大规模训练(3.5T tokens)表明,该方法能显著降低 Perplexity(PPL),并提升下游任务性能。 训练稳定性大幅提升,Loss Spikes(损失刺状突增)几乎消失,允许使用更大的学习率。

理解难点识别

核心难点:理解为什么一个简单的“乘法门控”就能消除根深蒂固的 Attention Sink 现象,以及它如何缓解 Massive Activation。 最具挑战性的部分:直觉上理解“线性瓶颈”与“非线性门控”在特征表达上的差异,以及“Query-Dependent”的稀疏性是如何运作的。 需要重点解释的核心概念:SDPA Output Gating(SDPA输出门控)。这是论文中效果最好、也是最核心的变体。

概念依赖关系

要理解 SDPA Output Gating,需要理清以下概念链条: Standard Attention(产生混合信息) -> Linear Projection Bottleneck(线性能力的局限) -> Gating Mechanism(引入非线性与筛选能力) -> Sparsity(结果:消除噪声与黑洞)。解释的最佳切入点是从标准 Attention 的“无法拒绝信息”这一缺陷入手。

第二阶段:深入解释核心概念

此阶段重点是引入比喻并将比喻和公式符号联系在一起

生活化比喻

想象你正在参加一个嘈杂的鸡尾酒会(这就是模型的上下文窗口),你戴着一副耳机。

没有门控的 Attention(传统 Softmax):这副耳机是“必须收听型”的。Softmax 的规则要求你必须分配 100% 的注意力份额。即使周围全是毫无意义的噪音(无关的 Token),或者大家都在说废话,你也不能把耳朵闭上。为了应付这个规则,你只好盯着墙上的一个挂钟(第一个 Token,即 Attention Sink)猛看,假装你在认真听,实际上是在放空,只为了消耗掉这 100% 的注意力份额。这让你非常累(产生 Massive Activation,高激活值),而且容易被突如其来的巨响吓到(训练不稳定)。

带有 SDPA 门控的 Attention(本文方法):现在,你戴上了一副“智能降噪耳机”。这副耳机有一个智能旋钮(Gate)。虽然 Softmax 依然让你采集了周围 100% 的声音,但在声音进入你的大脑(下一层网络)之前,这个智能旋钮会根据你当前想听的内容(Query),迅速判断采集到的声音是否有用。如果它发现采集到的全是噪音,旋钮会瞬间归零(Sigmoid 输出接近 0),直接切断声音信号。你不需要再盯着挂钟发呆了,因为你可以选择“什么都不听”。

比喻与实际技术的对应关系

周围采集到的声音:Attention 机制计算出的加权 Value 值(Context Vector,即 )。 必须要听 100% 的规则:Softmax 的归一化特性(所有权重加起来等于 1)。 盯着挂钟看:Attention Sink 现象(为了满足 Softmax 而人为制造的高权重 Token)。 智能旋钮:本文提出的 Sigmoid Gating。 旋钮归零:门控输出接近 0,产生稀疏性(Sparsity),阻断无关信息流向下一层。

合理性解释

这个比喻精准地捕捉了 Softmax 的“强制归一化”缺陷与 Gating 的“拒绝能力”之间的互补关系。Softmax 负责“找最相关的”,而 Gating 负责“判断整体是否有用”。

第四阶段:实验设计与验证分析

主实验设计:核心论点的验证

核心主张:给 Attention 加一个门控(Gating)能显著提升 LLM 的性能和训练稳定性。 模型设置:作者没有在小模型上小打小闹,而是训练了 15B 参数量的 MoE(Mixture-of-Experts)模型 和 1.7B 的 Dense 模型。 数据与训练:使用了高达 3.5T 到 4T token 的高质量数据集(包括多语言、代码、数学),这是非常扎实的 Pre-training 规模。 评价指标:Perplexity(PPL)作为语言建模能力的基础指标;MMLU、GSM8k(数学)、HumanEval(代码)等作为下游任务能力的综合评估。 基线方法:对比了标准的 Transformer,以及多种增加参数但无门控的变体(如增加 Head 数量、增加 Expert 数量),以确保性能提升不是单纯来源于参数量的增加。 实验结论: 加了门控(特别是 SDPA Output Gating)的模型,PPL 显著降低。 在各项权威榜单上,Gated Attention 模型的得分全面优于基线。 证明了该机制在高算力投入下的有效性和可扩展性。

深度/创新性实验剖析:洞察方法的内在特性

可视化分析:Attention Sink 的消失

实验设计:作者绘制了 Attention Map,观察模型到底关注哪些 Token。 结果:基线模型平均有 46.7% 的注意力都给了第一个 Token(典型的 Attention Sink)。而加了门控的模型,只有 4.8% 的注意力在第一个 Token 上。 洞见:门控机制天然地消除了 Attention Sink。模型不需要再找一个“垃圾桶”Token 来存放多余的注意力,因为它可以直接通过门控把无用信息“关掉”。

稳定性分析:Massive Activation 与 Loss Spike

实验设计:统计各层的隐藏状态激活值大小,并观察训练 Loss 曲线。 结果:基线模型的激活值非常大(Massive Activation),且训练中 Loss 经常突然飙升(Spike)。加了门控后,激活值大幅下降,Loss 曲线变得非常平滑。 洞见:更小的激活值意味着训练更稳定,减少了 BF16 训练时的数值溢出风险,这对于训练超大模型至关重要。

鲁棒性实验:长文本外推(Length Extrapolation)

实验设计:用 32k 长度训练,然后结合 YaRN 技术扩展到 128k 长度进行测试(使用 RULER Benchmark)。 结果:加了门控的模型在超长上下文(64k, 128k)下的表现显著优于基线。 洞见:消除 Attention Sink 后,位置编码(RoPE)的分布变化对模型的影响变小了。模型更依赖基于内容的门控选择,而不是位置偏差,因此对外推更鲁棒。

本文题目:Gated Attention for Large Language Models: Non-linearity, Sparsity, and Attention-Sink-Free

Comments NOTHING